Содержание

Содержание

- Критерии выбора инструмента мониторинга позиций.

- Сравнение стоимости проверок в сервисах и в SERP Parser.

- Различия редакций SERP Parser.

- Интерфейс.

- Настройка программы.

- Возможности SERP Parser Professional.

Я долгое время искал и пробовал разный софт и сервисы, с помощью которых можно проверять позиции сайта. Этот список с ценами приведен в таблице в посте «Чем проверять позиции сайта».

Здесь важно пояснить, что речь не идет о парсинге десятка фраз. Потому что, в таком случае, достаточно было бы воспользоваться бесплатной программой SiteAuditor. Но функционал SiteAuditor слишком прост, и баны поисковых систем просто неизбежны. А мне нужно проверять видимость сайта по сотням запросов.

Критерии отбора

Для меня было важно, чтобы информация была:

- Бесплатной или недорогой.

- Актуальной (позиции соответствуют действительности).

- Наглядной (отображалась динамика по каждому запросу).

- Представлена в удобном для восприятия виде (красивый дизайн).

- Конфиденциальной (возможно это не так уж и критично, но… тоже не лишнее).

Я пробовал Topvisor, Sitexpert, Top-Inspector, Seranking, но хотелось найти чего-нибудь более бюджетное. Спрашивал у знакомых, кто чем проверяет позиции. Одни включают Кейколлектор, другие некоторое время бесплатно пользовались Мегаиндексом. Но потом перешли на SERP Parser. Мне стало интересно, что это за программа такая и я решил ее потестить. Но перед знакомством с программой, сначала произведем очень простые расчеты.

Расчет стоимости проверок

Давайте посчитаем, во сколько обойдется нам проверка позиций сайта в онлайн-сервисах, если минимальная стоимость парсинга одного ключа в одном поисковике стоит 4 копейки.

Проверка тысячи запросов в Яндексе и Гугле составляет:

1 000 × 4 × 2 = 8 000 коп. = 80 руб. = 1,4$

Учитывая, что в Гугле выдача меняется практически ежедневно, то, чтобы быть в курсе всех изменений, стоимость проверки за месяц будет:

1 000 × 4 × 30 = 120 000 коп. = 1200 руб. = 21,07$

Если мы говорим о поисковой системе Яндекс, то выдача может меняться как несколько раз за неделю, так и вообще не обновляться. Особенно в последнее время. (Произошел ли апдейт можно узнать на сайте tools.promosite.ru).

Есть ли необходимость в ежедневном мониторинге позиций или достаточно делать проверки только после апдейтов Яндекса? Конечно, в большинстве случаев достаточно мониторить позиции только несколько раз в месяц, но видеть актуальные позиции сайта на каждый день все-таки удобнее.

Так вот, если определять позиции сайта в Яндексе только после апдейта, возьмем, к примеру 7 раз в месяц, то бюджет составит:

1 000 × 4 × 7 = 28 000 коп. = 280 руб. = 4,92$

Итого:

21,07$ (ежедневные проверки в Гугле)

+

4,92$ (семь проверок в Яндексе)

=

25,99$

И это только проверка одного сайта!

Если ежедневно проверять позиции сайта в Гугле а в Яндексе после апдейтов, то при покупке годовой лицензии SERP Parser Professional программа отобъется практически за месяц!

А если вы продвигаете все один сайт, то можете купить Lite версию, срок окупаемости которой составит 11 дней.

| Лицензия на год | Цена | ~ Срок окупаемости |

|---|---|---|

| SERP Parser Professional | $29.90 | 35 дней |

| SERP Parser Base | $19.90 | 17 дней |

| SERP Parser Lite | $9.90 | 11 дней |

Стоимость продления лицензии на один год составляет 45% от ее полной стоимости. Например, стоимость продления лицензии SERP Parser Lite на год составляет 4,45$. Этой суммы не хватит даже на 7 проверок в Яндексе

Конечно, для пользования десктопной версией, в отличие от онлайн-сервисов, понадобятся свои прокси и положительный баланс в Antigate. Прокси можно найти в открытом доступе, а для распознавания тысячи каптч достаточно всего одного доллара.

Вывод: даже самая дорогая версия Pro обходится дешевле самых дешевых сервисов, а Lite окупается быстрее, чем срок бесплатного 14-тидневного тестового периода SERP Parser

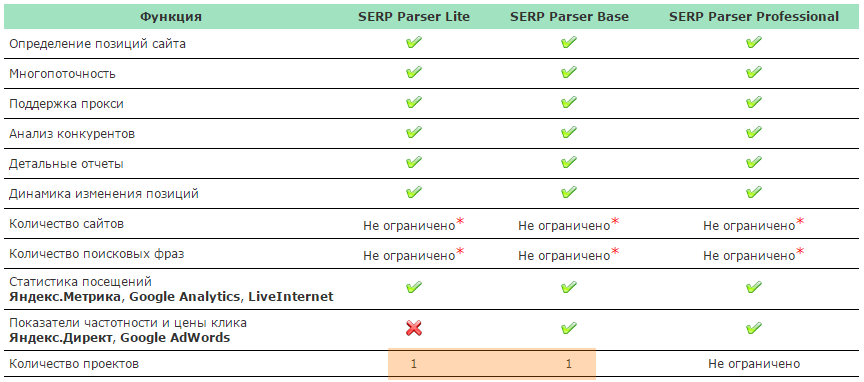

Различия редакций

В версии Pro количество проектов неограниченно.

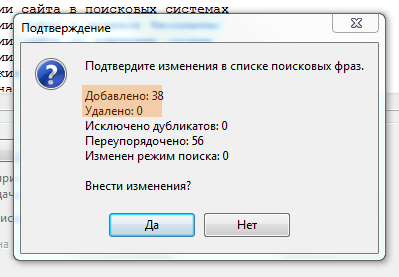

Интерфейс

Возможно программа выглядит как классический десктоп, с классическими элементами управления, но мне как визуалу, хочется помечтать и представить как этот мощный функционал мог бы выглядеть по-новому. Но в таком виде как она есть, программа напоминает девяностые года, когда я учился в политехе. Тогда мы писали программы на Delphi и базы данных на Access. Золотое время!

Я понимаю, что для этого придется переделать всю оболочку. Так что это — просто мое пожелание для разработчиков. Мне кажется, надо сделать кнопочки плоскими и лаконичными.

Например, у PageWeight неплохие кнопки.

Еще более современно выглядит интерфейс программы для создания скриншотов Сlip2net.

Было бы неплохо убрать лишние линии. Потому что когда их четыре, возникает визуальный шум.

Знакомство с SERP Parser’ом

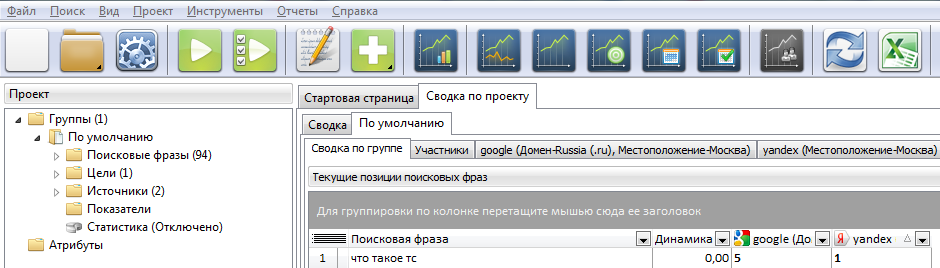

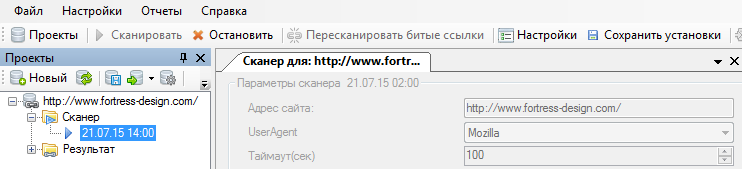

При первом запуске программы нужно создать новый проект и добавить ключевые слова. В этом вам поможет мастер создания проекта.

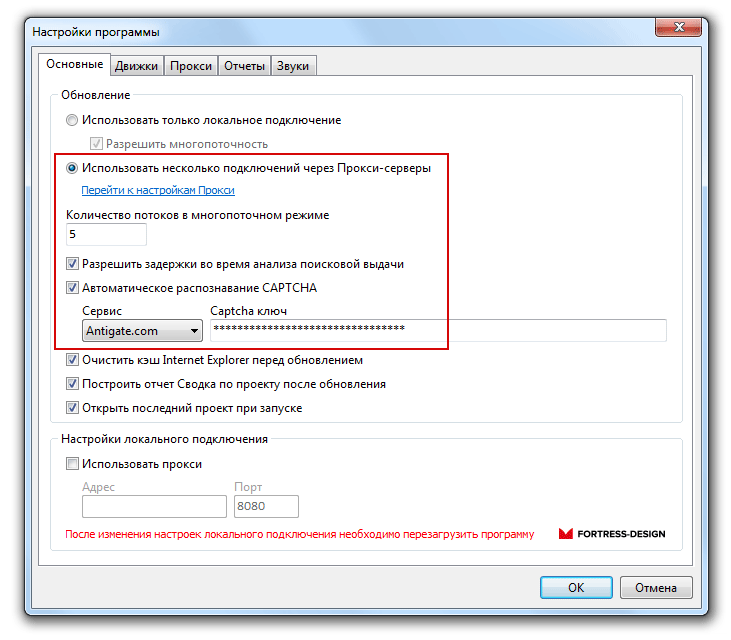

Настройка программы

Параметр «Останавливать анализ при обнаружении цели» ограничьте глубиной поиска Топ-50, этого вполне достаточно. При добавлении укажите адрес анализируемого сайта.

В качестве источников поисковых систем выберите Яндекс и Google, при необходимости указав региональность.

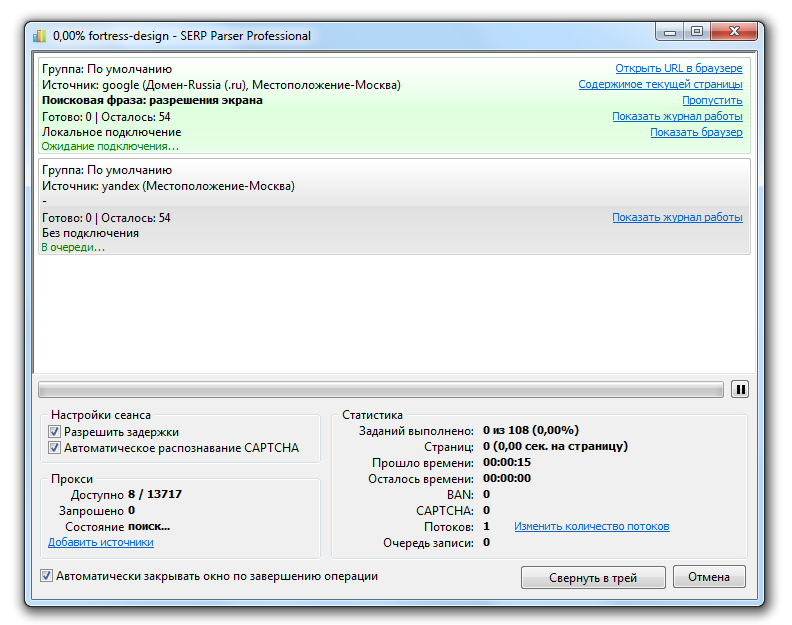

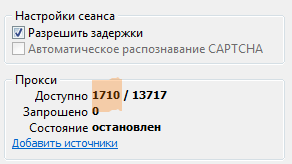

Чтобы поисковики не забанили ваш IP, обязательно используйте подключение через прокси! Их можно найти в открытом доступе. Чем больше прокси, тем больше потоков можно поставить, тем выше скорость проверки. Но при этом не отключайте задержки в процессе парсинга выдачи.

А чтобы проверка позиций не превратилась в муку, зарегистрируйтесь в Antigate.com. Пополните баланс хотя бы на один доллар и сэкономьте массу времени.

Сделав все настройки, сохраните проект и запускайте процесс снятия позиций. Выглядит это примерно так:

Пожелание для внедрения в новые версии

Прокси, которые программа определила как забаненные, отмечать или переносить в отдельный список или добавить кнопку «Удалить нерабочие прокси». Это позволит не тратить время при очередном запуске программы на повторное сканирование ранее забракованых серверов.

Как добавить новые запросы

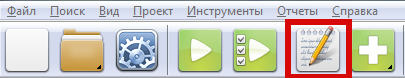

По мере развития проекта вам понадобится добавить новые ключевые фразы. Нажмите на кнопку «Управление поисковыми фразами».

В открывшееся окно добавьте новые запросы и нажмите кнопку ОК.

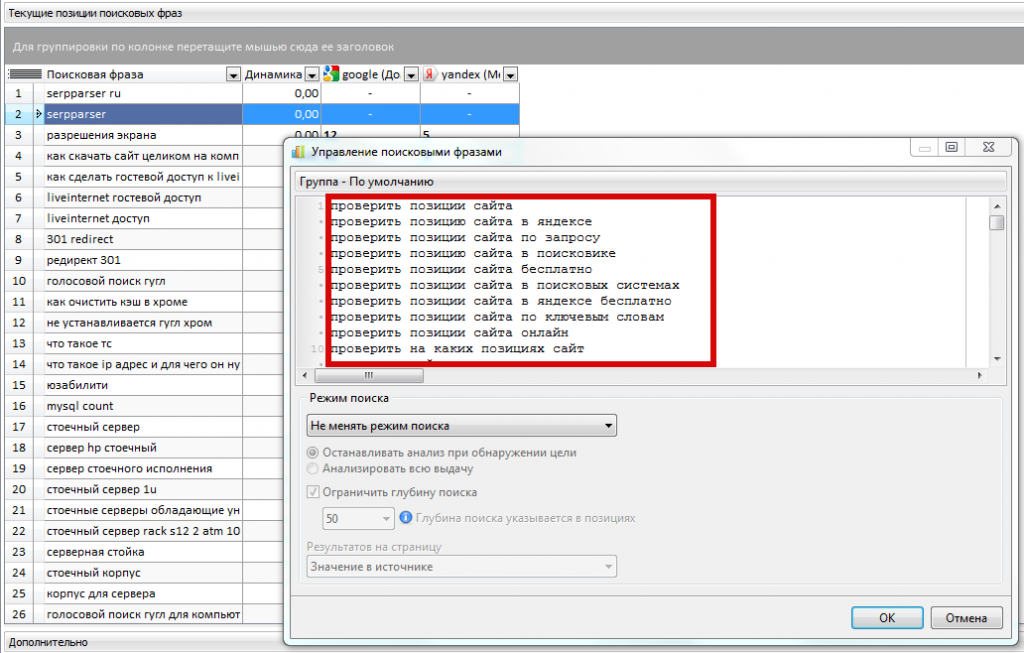

После этого, в качестве подтверждения, отобразится статистика.

Важно! Следует обратить внимание на одну особенность: программа не считает дубликатами фразы, написанные в разном регистре.

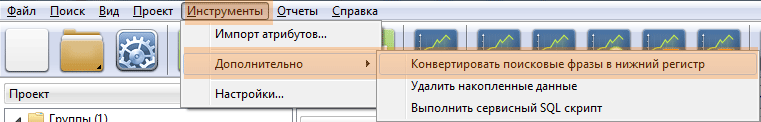

Если фразы все же добавлены в проект в разном регистре, то сменить на нижний регистр можно с помощью команды меню Инструменты → Дополнительно → Конвертировать поисковые фразы в нижний регистр.

И это верно, потому что с точки зрения поисковой системы два одинаковых ключа, один из которых написан с прописной буквы — это разные ключи.

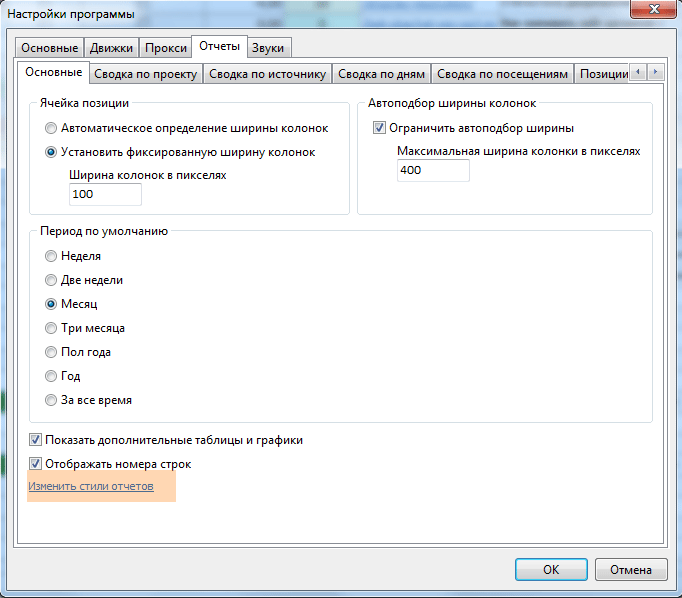

Отчеты в SERP Parser Pro

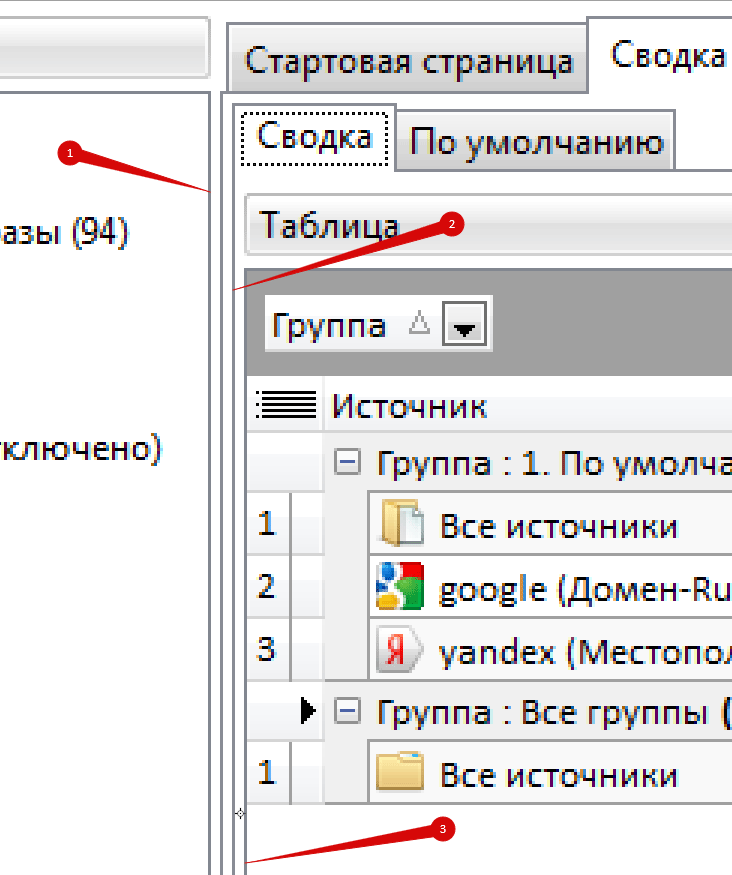

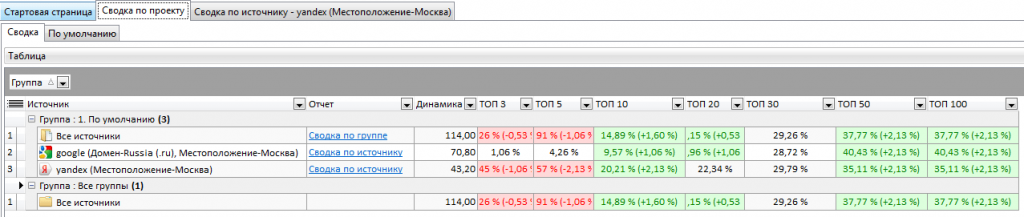

Видов отчетов много и все они настраиваемые. Вот так выглядит отчет по проекту.

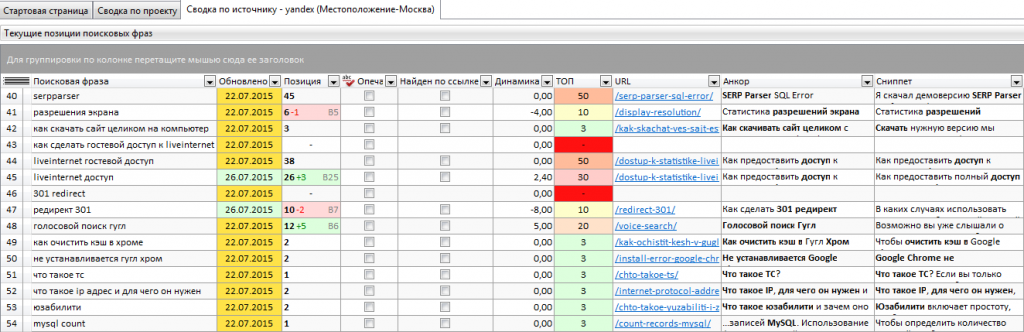

Отчет по источнику.

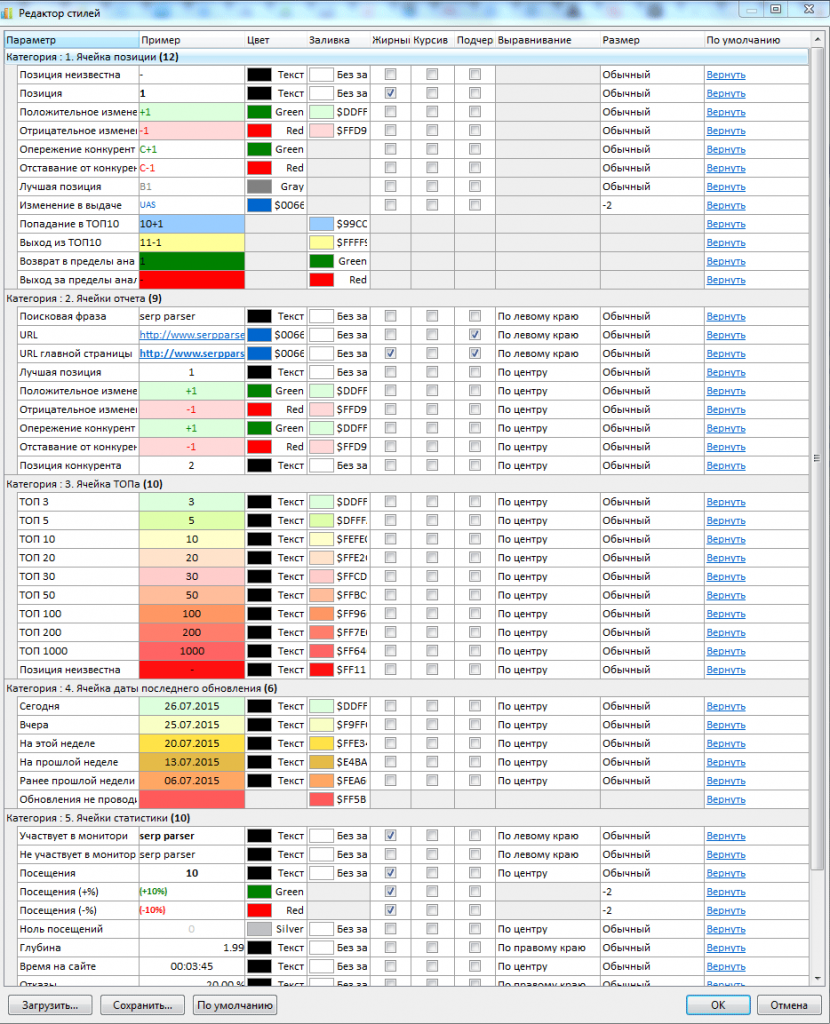

И так далее. Кстати, цвета ячеек вы можете отредактировать а редакторе стилей.

Это окно вызывается при клике на секретную ссылку.

[sociallocker]

Возможности программы

Вообще программа очень богата функционалом и настройками. В некоторых случаях, по моему, он даже избыточен. Назову лишь несколько.

- Многопоточная проверка позиций.

- Возможность парсить очень большие количества запросов, хоть 10 тысяч.

- Несколько видов отчетов в разных форматах.

- Атрибуты — это пользовательские колонки в отчетах. Их можно использовать для группировки запросов на ВЧ, СЧ и НЧ-запросы, что сделает ваши отчеты еще информативнее.

- Возможность гибко настраивать сам процесс мониторинга: задержки, паузы, прокси, AntiGate.

- Снятие сниппетов.

- SERP браузер отображает по каждому поисковому запросу тайтл, сниппет, адрес страницы в том виде, в каком они представлены на странице выдачи ПС.

На самом деле их гораздо больше. Просто чтобы перечислить все возможности, понадобится написать не одну статью.

Кстати, у вас может возникнуть вопрос как отключить звуки, которые слышны при парсинге. Это легко настраивается в панели управления, посмотрите мини-инструкцию по ссылке.

Заключение

Программа работает стабильно и соответствует четырем критериям отбора, и только по одному пункту требует определенной доработки. Поэтому заслуженно получает 4 балла из 5 возможных. Уверен, что проект будет развиваться и станут говорить, если проверять позиции, то в Серппарсере.

Плюсы сервисов — нет нужды выделять свои ресурсы для парсинга, искать прокси и распознавать капчи, мониторить позиции можно с планшета или смартфона. Однако есть и минусы:

- Все сервисы хранят ваши фразы у себя. Как правило сервисы внедряют интеграцию с Гугл аналитикс и/или Яндекс.Метрику. В итоге у них есть огромные аналитические данные, которыми могут воспользоваться в своей SEO-компании, либо быть переданы третьим лицам. Используя скрипты и программы, данные никуда не отправляются и остаются в секрете, как это и должно быть.

- В период нагрузки, практически все сервисы задерживают отчеты. Это и понятно, в период апа большинство пользователей идут проверять позиции и создают нагрузку на сервис. В итоге, когда позиции нужны больше всего, их приходится ждать несколько часов. В программе таких задержек нет, позиции будут проверены сразу, как только они понадобились.

Это очевидные минусы. Возможно есть и другие, которые вы подскажете. А чем вы проверяте позиции?