Содержание

Роботы-пауки поисковых систем постоянно обходят весь интернет в поисках новых и обновленных страниц. Иногда проходит немало времени, прежде чем они вернутся на ваш сайт и обнаружат добавленные страницы. Можно ли что-то сделать для ускорения процесса?

Возможно вам уже приходилось строить самую простую и примитивную версию поисковой системы с ее базовыми компонтентами, среди которых — робот-паук, он же web crawler. Это программа, которая заходит на страницу, отправляет ее содержимое в индекс поисковика, ищет на странице ссылки, переходит по ним и повторяет весь процесс. Конечно, тут есть множество тонкостей: например, далеко не все страницы связаны друг с другом. Но общий принцип понятен. И сразу же вылезает основная проблема: огромный объем данных.

Вспомните о халифе, который сказал, что даст мудрецу столько пшеницы, сколько поместится на шахматной доске, если класть на каждую следующую клетку в 2 раза больше зернышек. Казалось бы, удвоить 64 раза — ну, не такое большое число получится. Но на самом деле это 2 в степени 64, то есть 1,2 триллиона тонн зерна (если считать по 1 млн зернышек на тонну).

У Google показатели пока в 100 000 раз скромнее: согласно исследованию Statistic Brain, в 2015 году в индексе поисковика было 30 триллионов страниц. Размер индекса — 100 000 терабайт. Чтобы ворочать всей этой махиной компании нужно порядка 1 млн мощных серверов (конечно, не все они используются для нужд поиска, но все же).

Все эти цифры мы привели ради ответа на простой вопрос: почему роботы поисковиков так редко посещают страницы, чтобы переиндексировать внесенные вами изменения? Как вы теперь догадываетесь, проблема не только в количестве страниц и объеме сырых данных, но и в том, что их нужно как-то обработать, обсчитать, отранжировать. Все это ест машинное время и радует производителей серверов, у которых Google и Яндекс их покупают.

Теперь давайте перейдем от теории к более насущным практическим вопросам: как ускорить индексацию и увеличить частоту визитов роботов-пауков?

Приманиваем робота Google

1. Убедитесь, что вы автоматически генерируете карту сайта (файл sitemap.xml) и отдаете ее Google. Подробная есть в хелпе «Яндекса», и именно на нее стоит ориентироваться. Инструкции для Google точно такие же. Практически все современные CMS позволяют автоматически генерировать sitemap.xml, в котором собраны все ссылки на присутствующие на сайте страницы, которые нужно индексировать (но не более 50 000), а также дополнительная информация: дата изменения, планируемая частота изменений, относительная важность конкретной страницы по сравнению с другими документами на сайте.

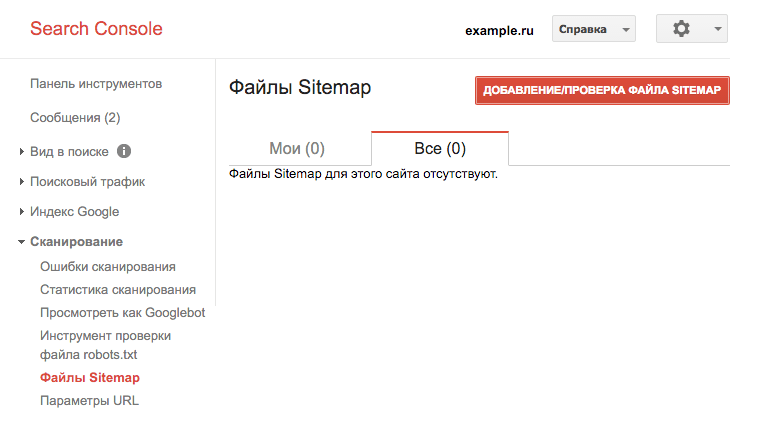

Если вы наблюдаете такую картину в панели инструментов вебмастера Google ( ), то обязательно нажмите на красную кнопку и добавьте ссылку на свой sitemap.xml. Ее также нужно прописать в robots.txt.

User-agent: *

Allow: /

Sitemap: //example.com/sitemap.xml

Если вы выкатили сверхсрочный апдейт, которому очень хорошо бы побыстрее оказаться в индексе, можете нажать на кнопку «Добавление/Проверка файла SITEMAP», даже если у вас уже добавлен sitemap.xml. В некоторых случаях это может привести к ускорению переиндексации перечисленных в карте сайте страниц.

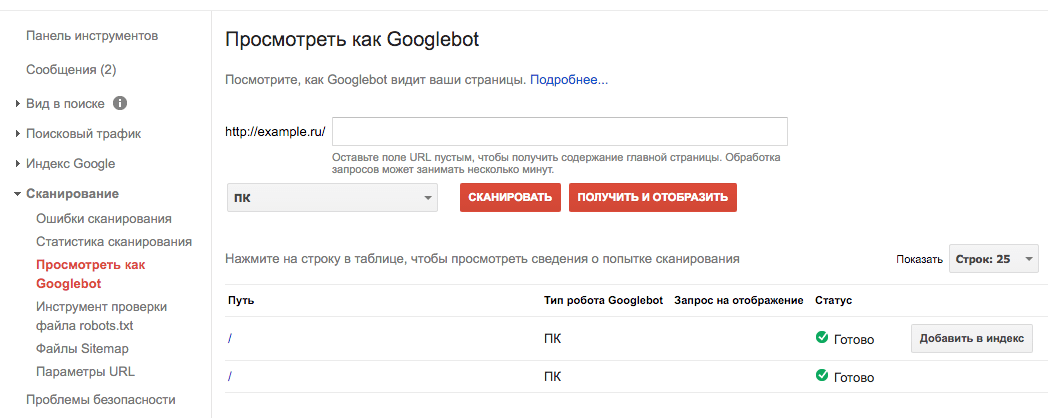

2. Чтобы быстрее добавить в индекс какой-то документ или попытаться вызвать переиндексацию, можно зайти во все ту же Search Console, перейти в раздел «Сканирование» и выбрать пункт «Посмотреть как Googlebot». Вводите URL, нажимаете на «Сканировать», а затем нажимаете на появившуюся кнопку «Добавить в индекс».

Ускоряем индексацию в «Яндексе»

Приведенный выше совет про карту сайта актуален и для «Яндекса». Также обязательно прочтите . Откровений там нет, но все указанное сделать нужно обязательно. А теперь перейдем к методикам, которые там не перечислены.

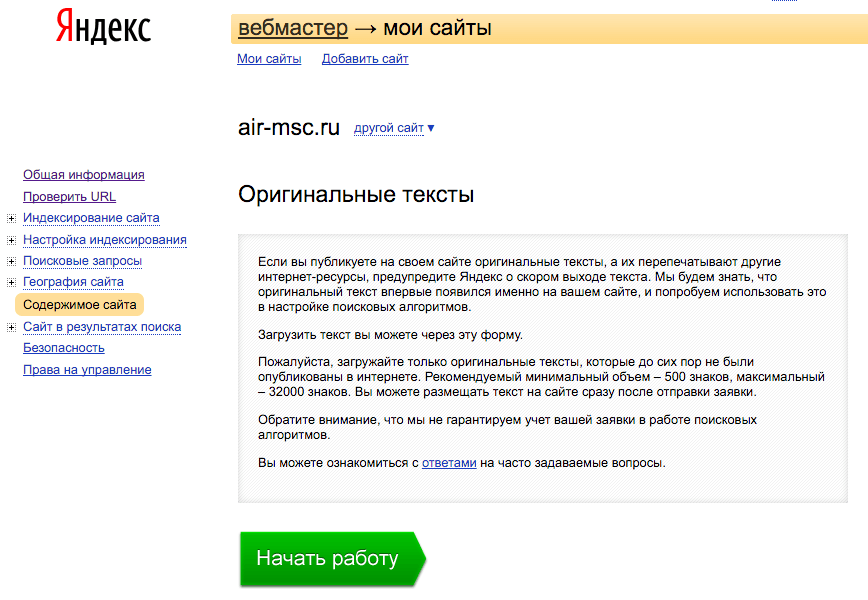

«Оригинальные тексты»

Перейдите в раздел «Содержимое сайта» и кликните на ссылку «Оригинальные тексты». К сожалению, сервис не позволяет указать URL, на котором размещен текст. Однако если с вашего сайта часто сабмитятся новые материалы, это будет сигналом для уменьшения периода между индексациями. Стоит отметить, что можно наладить через API «Яндекса», и мы настоятельно рекомендуем это сделать. Ускорение индексации — это лишь побочный бонус, защита контента от воровства намного важнее.

«»

Универсальные способы

Распространение ссылки через соцсети

Очень хороший способ привлечь внимание поисковиков — запостить ссылку на новую страницу в Twitter, Facebook и «ВКонтакте». У поисковиковых систем есть специальные блоговые боты, которые индексируют соцсети. Безусловно, тут все зависит от прокачанности ваших собственных аккаунтов и интереса, который пост вызовет у подписчиков. Пост без ретвитов в аккаунт с десятком читателей может пройти незамеченным.

RSS-канал

RSS давно пророчат смерть, особенно после закрытия Google Reader. Это технология для гиков, но те, кто ей пользуются, очень ее ценят. Да и поисковые системы воспринимают наличие настроенного RSS-канала (желательно, чтобы последний материал в нем всегда был свежим) как положительный сигнал и повод почаще присылать бота-паука.

Перелинковка

Во-первых, все новые страницы должны быть достижимы по ссылкам с других страниц, иначе бот их вряд ли найдет. Во-вторых, если вы заметили, например, что бот переиндексирует раздел с новостями часто, а со статьями — редко, то новую статью, которую хочется поскорее добавить в индекс, можно анонсировать (со ссылкой, разумеется) в отдельной новости.

Вывод

Способов напрямую влиять на скорость индексации нет, но качественные сайты с регулярно обновляемым оригинальным контентом поисковики любят. А если робот все-таки пока что не ходит к вам часто, не расстраивайтесь: SEO — это в любом случае игра вдолгую.

© bdbd.ru

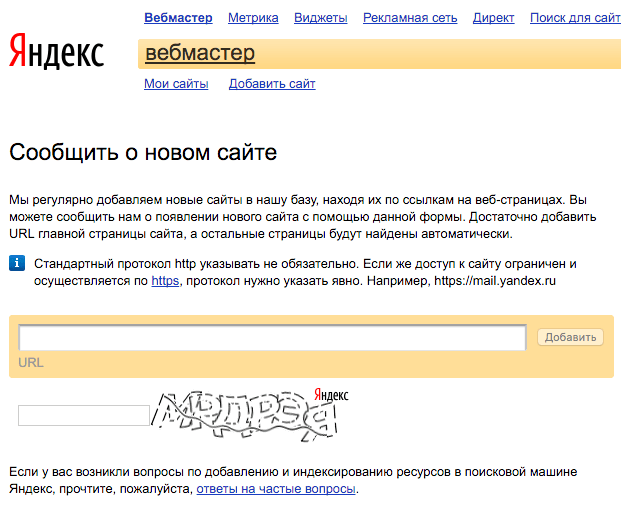

Вот еще вариант, для первого толчка —